2026年AIガバナンスと規制強化:企業に求められる対応と準備

2026年AIガバナンスと規制強化:企業に求められる対応と準備

はじめに:「是正の年」としての2026年

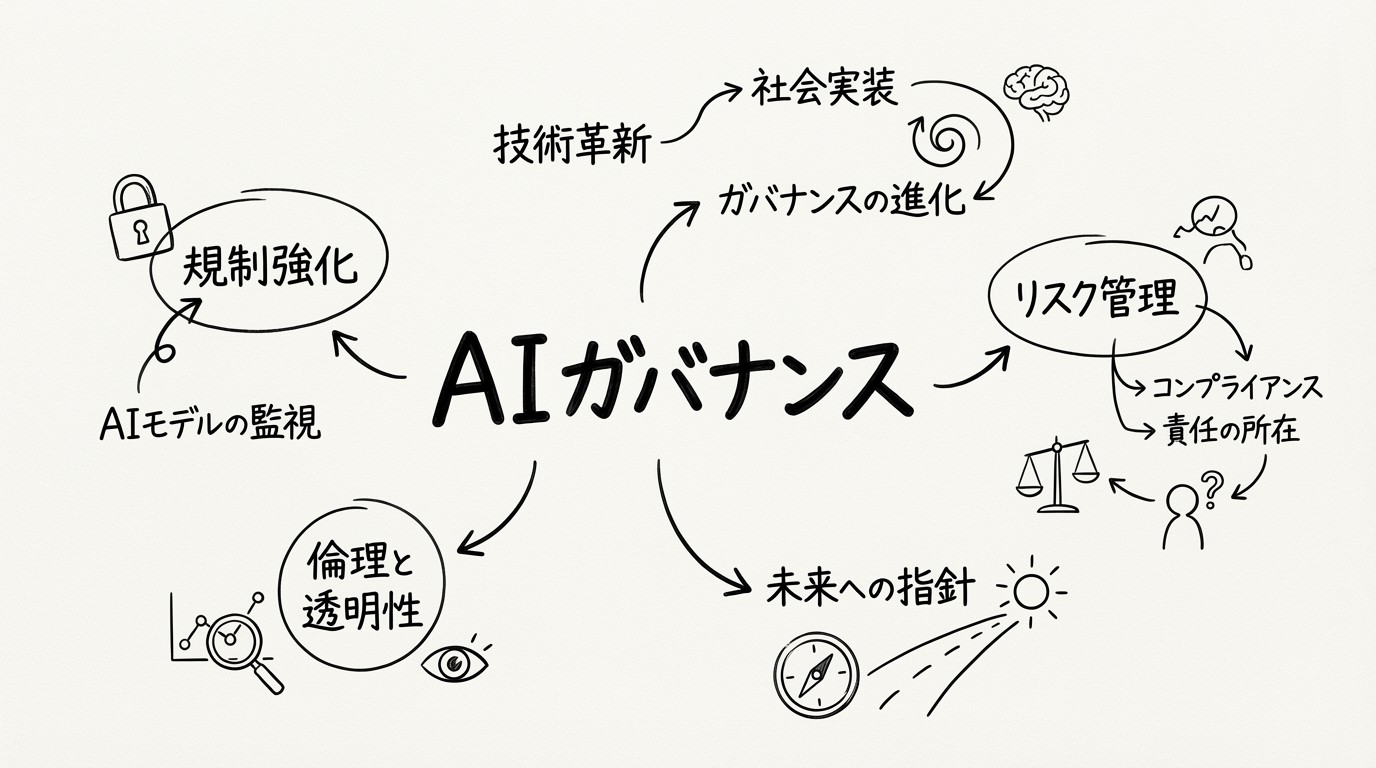

2026年は、企業におけるAI活用が新たな局面を迎える重要な年です。ForresterやGartnerなどの主要調査機関は、2026年をAIの「ハイプ(過度な期待)」が終わり、実利とリスク管理が優先される「是正の年(Year of Correction)」と位置づけています。

これまで「実験的導入」のフェーズにあったAI活用は、2026年を境に厳格な「ガバナンス」と「事業成果(ROI)」が問われる実行フェーズへと完全に移行します。本記事では、2026年に向けたAIガバナンスの世界的潮流と、日本企業が直面する規制環境の変化、そして具体的な対応策について解説します。

AI統括責任者(Head of AI Governance)の時代

Fortune 100の60%が専任責任者を設置

Forresterの予測によれば、2026年にはFortune 100企業の60%が、専任の「AI統括責任者(Head of AI Governance)」を任命するとされています。これは、EU AI Actをはじめとする世界的な規制強化や、各国で断片化する法規制への対応が、従来のCIO(最高情報責任者)やCISO(最高情報セキュリティ責任者)の兼務では対応しきれないほど複雑化していることを示しています。

すでにSony、Bank of America、UBSなどの主要グローバル企業はこの措置を講じており、AIガバナンスの専任化は、コンプライアンス遵守だけでなく、AI活用によるビジネス価値の創出を阻害しないための戦略的投資と見なされています。

AI統括責任者に求められる役割とスキル

AI統括責任者(あるいはCAIO: Chief AI Officer、Co-CAIO)には、技術的な知見以上に、経営戦略とリスク管理を統合する能力が求められます。

主な責任範囲

まず、EU AI Act、米国の州法、日本のAI推進法など、多岐にわたる規制への適合性を確保する規制対応の指揮が挙げられます。2026年のトレンドである自律型AIエージェント(Agentic AI)の展開においては、その自律的な意思決定プロセスを監視・制御する「Agentlakes」アーキテクチャのガバナンスも重要な責務となります。

さらに、AI投資の財務的成果をCFO(最高財務責任者)に対して明確に示すROIの証明も不可欠です。Forresterは、2026年にはCFOがAI投資の意思決定により深く関与し、ROIが不明確なプロジェクトは凍結されると予測しています。

求められるスキルセット

技術導入を目的化せず、エンドツーエンドのビジネスプロセスにAIを統合し、効率と成長を牽引する戦略的洞察力(Strategic Acumen)が必要です。また、技術用語ではなく、財務・経営用語でAIの価値とリスクを説明し、ステークホルダー(特にCFO)の信頼を得るビジネス価値の言語化能力も欠かせません。

加えて、イノベーションを阻害せずに、差別やバイアス、プライバシー侵害などの「社会的リスク」を最小化する倫理とリスクのバランス感覚が求められます。

Gartner「AIフリー」スキル評価の衝撃

クリティカルシンキング能力の低下への警鐘

Gartnerの「2026年以降の戦略的予測」において最も衝撃的な予測の一つが、「2026年までに、生成AIの利用によるクリティカルシンキング(批判的思考)能力の低下(atrophy)に対応するため、世界の組織の50%が『AIフリー』のスキル評価を導入する」というものです。

生成AIの普及により、従業員がAIの出力結果に過度に依存し、自ら思考・検証するプロセスを省略する「思考の怠慢(Lazy Thinking)」が懸念されています。Gartnerのアナリストは、「AIがあなたのスキルを奪っている(AI is stealing your skills)」と警告しており、AIなしでは業務遂行や問題解決ができない人材が増加するリスクを指摘しています。

人材評価の新しい指標

この予測は、企業がAI活用を推進する一方で、人間の根源的な能力を再評価する必要性に迫られていることを示唆しています。

採用プロセスや昇進試験において、あえてAIツールの使用を禁止し、候補者自身の論理的思考力、創造性、倫理的判断力を測定するAIフリー評価の導入が始まっています。AIによる自動化が進む中で、独立した思考や創造性は希少価値が高まり、企業は「AIを使いこなすスキル」と「AIに依存しない基礎能力」の両方をバランスよく評価するハイブリッドな人材マネジメントへと移行します。

2027年までには、採用プロセスの75%に「職場でのAI習熟度」を確認するテストが含まれる一方で、その前提となる基礎能力の確認も厳格化されるという二極化が進むと予測されています。

EU AI Act完全施行への対応

2026年8月の重要な節目

EU AI Act(欧州AI法)は2024年8月に発効しましたが、企業にとって最も影響が大きい「高リスクAIシステム」に関する規制は、2026年8月2日より適用が開始されます。

段階的な施行スケジュールは以下の通りです。2025年2月には禁止されるAI慣行(ソーシャルスコアリング等)の適用が開始され、2025年8月には汎用AI(GPAI)モデルに対するガバナンス規則が適用されます。そして2026年8月2日、高リスクAIシステム(Annex III)に対する義務の適用が開始されます。これには、重要インフラ、教育・職業訓練、雇用管理、必須の民間・公共サービス(信用スコアリング等)などが含まれます。

日本企業が直面する課題

日本企業であっても、EU市場でAIシステムを提供、またはEU域内のユーザーに向けてAIを利用する場合、この規制の対象となります。

高リスクAIへの対応要件

市場投入前に、第三者機関または自己評価による適合性評価を実施し、CEマークを取得する必要があります。AIシステムのライフサイクル全体を通じた継続的なリスク管理プロセスの確立も求められます。

学習データの品質(バイアスの排除、適切性)を保証するデータガバナンス、ユーザーへの情報提供義務と、人間がAIの動作を監視・介入できる仕組み(Human-in-the-loop)の実装による透明性と人間による監視、そして当局が検証可能な詳細な技術文書の作成と動作ログの自動記録が必要です。

2026年8月の期限に向け、日本企業は自社のAI製品が「高リスク」に該当するかどうかの棚卸しを完了し、該当する場合は技術文書の整備や品質管理体制の構築を急ぐ必要があります。違反時の制裁金は最大で全世界売上高の7%または3,500万ユーロに達するため、経営リスクとして捉えるべきです。

日本企業のガバナンス体制構築事例

AIガバナンス体制の構築には、多様なステークホルダーの協働が不可欠

日本国内でも、2024年から2025年にかけて、主要企業がAIガバナンス体制を急速に整備しています。

NTTグループ:Co-CAIOとAIガバナンス室

NTTは2024年6月、「NTTグループAI憲章」等の規定を制定し、AIガバナンスを統括するCo-CAIO(Co-Chief AI Officer)を配置しました。

Co-CAIOを補佐する「AIガバナンス室」を新設し、グループ各社に「AIリスクマネジメント責任者」を配置する体制を構築しています。ユースケースごとにリスクを「禁止」「ハイリスク」「限定的リスク」に分類し、プロジェクトマネージャーとリスク管理責任者が二重にチェックする体制により、イノベーションを阻害せずにリスクを管理しています。

ソフトバンク:AI倫理委員会と実践的ガバナンス

ソフトバンクは2024年4月、社外有識者を含む「AI倫理委員会」を設立しました。

CISO(最高情報セキュリティ責任者)が委員長を務め、法学、消費者保護、ESGなどの専門家が参加しています。企画・設計段階で独自のリスクアセスメントを実施し、開発後もチェックリストで再確認するプロセスを導入し、EU AI Actなどの国際基準を参照したリスク評価を行っています。

富士通:国際基準への準拠と全社展開

富士通は「AI倫理ガバナンス室」を設置し、欧州のAI倫理コンソーシアム「AI4People」の創設メンバーとして国際的なルール形成に関与しています。

「富士通グループAIコミットメント」を策定し、全従業員向けの教育を徹底することで、AI倫理を一部の専門家の問題とせず、企業文化として定着させることを目指しています。

NEC:デジタルトラスト諮問会議

NECは2019年から「デジタルトラスト諮問会議」を運営しており、AIと人権に関するガバナンスを強化しています。

2024年以降は、生成AIやAIエージェントの導入に伴う新たな人権リスク(自律的な判断による差別など)について外部有識者に諮問し、そのフィードバックをポリシーに反映しています。

2026年までに企業が準備すべき具体的なアクション

2026年の規制強化と市場環境の変化に対応するため、日本企業は以下の具体的アクションを実行すべきです。

組織体制の整備:責任の明確化

技術部門と法務・リスク管理部門を橋渡しし、経営層(CFO/CEO)に対して説明責任を負う専任のAI統括責任者(CAIO/Head of AI Governance)を任命します。Forresterの予測通り、これはグローバル競争力の必須条件となります。

また、外部の視点(法律家、倫理学者、消費者代表)を取り入れ、客観的なリスク評価を行うAI倫理委員会/諮問機関を設置します。ソフトバンクやNECの事例がモデルとなります。

ガバナンスフレームワークの構築:ソフトローからハードロー対応へ

経済産業省・総務省が策定した「AI事業者ガイドライン(第1.0版/1.1版)」に基づき、AI開発者・提供者・利用者の各立場に応じたリスク管理プロセスを実装します。

欧州ビジネスを持つ企業は、2026年8月の高リスクAI規制適用に向け、製品のギャップ分析と技術文書の整備を完了させる必要があります。また、日本政府が2025年12月に閣議決定した「AI基本計画」に基づき、政府調達や重要インフラ分野でのAI活用要件(信頼性の確保)を満たす準備を行います。

リスク管理と人材戦略:防御と攻撃の両立

Gartnerの提言に従い、採用や評価において「AIを使わない思考力」を測定するAIフリースキル評価を導入し、組織のクリティカルシンキング能力の低下を防ぎます。

全てのAIを一律に管理するのではなく、NTTのようにリスクレベル(禁止、高、限定的)に応じた濃淡のある管理体制を構築し、イノベーションを阻害しないようにするリスクベース・アプローチを徹底します。

AI導入を「実験」で終わらせないために、CFOと連携してAI投資の財務的成果を測定するKPIを設定し、効果の出ないプロジェクトは早期に見直すROI管理の厳格化も重要です。

まとめ:三位一体の対応が競争優位を決める

2026年は、AIが「魔法のツール」から「管理された経営資源」へと変貌する年です。企業は、以下の三つの軸での対応が求められます。

守り:規制への対応

EU AI Actのような強力な規制への適合性を確保し、制裁金リスクを回避する体制を構築します。

攻め:戦略的な価値創出

AI統括責任者を中心に、ビジネスプロセスへのAI統合を進め、ROIを証明できるガバナンス体制を確立します。

人材戦略:人間の能力維持

AIフリースキル評価を導入し、クリティカルシンキング能力を維持しながら、AI活用スキルも高める二極化対応を実現します。

日本企業においては、政府のガイドラインや先行企業の事例を参考にしつつ、グローバル基準のガバナンス体制を早急に確立することが、競争優位を維持する鍵となります。2026年への準備は、今すぐに始めるべきです。

参考文献

- Forrester: "Predictions 2026: AI Governance and ROI Management"

- Gartner: "Strategic Predictions for 2026 and Beyond"

- EU AI Act Official Portal: europa.eu

- 経済産業省・総務省: 「AI事業者ガイドライン」

- NTTグループ: 「NTTグループAI憲章」

- ソフトバンク: AI倫理委員会公式発表

- 富士通: 「富士通グループAIコミットメント」

- NEC: デジタルトラスト諮問会議報告書