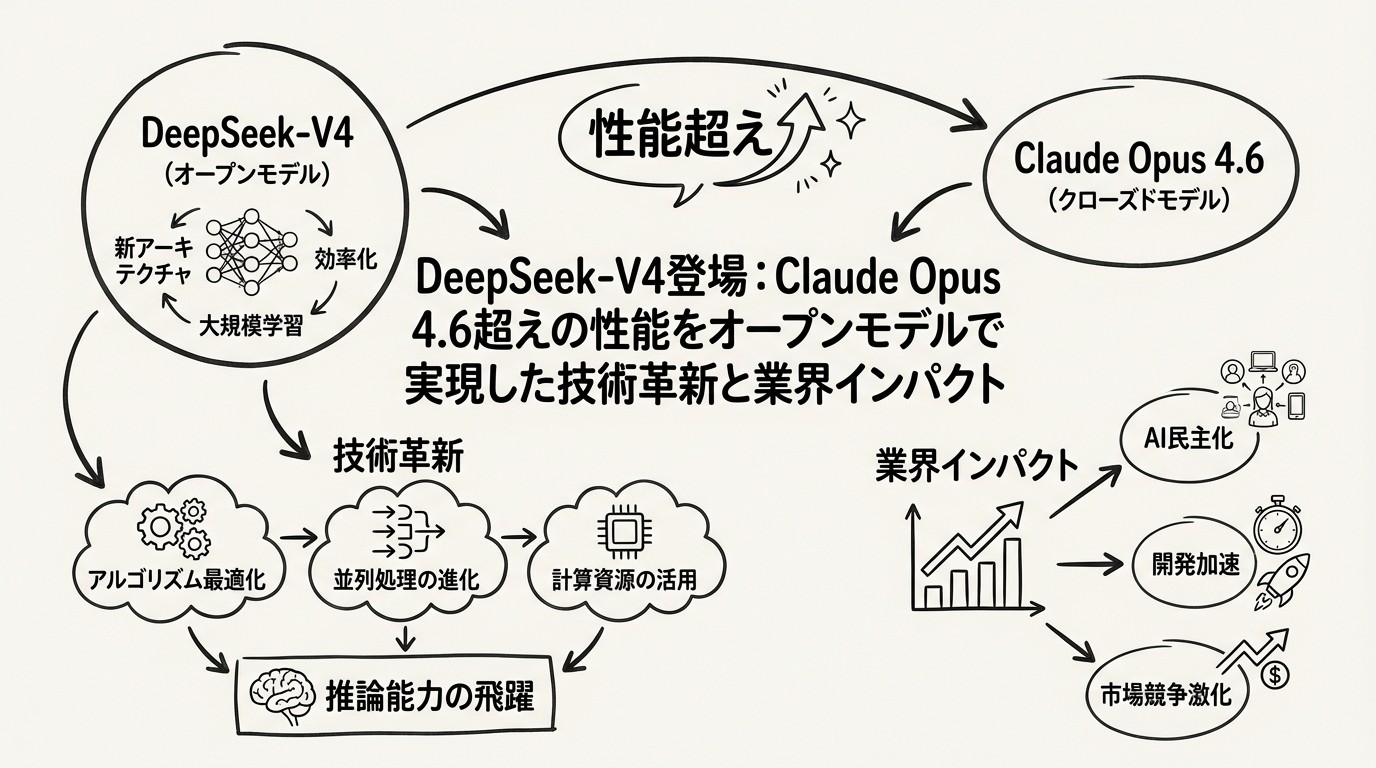

DeepSeek-V4登場:Claude Opus 4.6超えの性能をオープンモデルで実現した技術革新と業界インパクト

この記事は週間AIニュース(2026年4月27日週)の詳細版です。

2026年4月24日、中国のAI企業DeepSeekは次世代モデル「DeepSeek-V4 Preview」を公開しました。このモデルは、コーディングベンチマーク「LiveCodeBench」でClaude Opus 4.6を上回るスコアを記録し、オープンウェイトモデルがフロンティアクローズドモデルの性能を超えるという、AI業界の転換点を示しました。

本稿では、DeepSeek-V4の技術的特徴、ベンチマーク結果の詳細、業界への影響、そして日本企業がこの動きをどう活用すべきかを詳細に分析します。

概要:DeepSeek-V4とは何か

モデル構成

DeepSeek-V4は以下の2つのバリエーションで構成されています。

| モデル | 特徴 | 用途 |

|---|---|---|

| DeepSeek-V4-Pro | 最高性能モデル | 複雑な推論、コーディング、長文処理 |

| DeepSeek-V4-Flash | 軽量・高速モデル | リアルタイム応答、大量処理 |

両モデルとも100万トークンのコンテキスト長をサポートしており、これは約80万語〜100万語の英文、または数十万文字の日本語文書を一度に処理できることを意味します。

公開形態

DeepSeek-V4はオープンウェイト(Open Weight)として公開されています。これは、モデルの重み(学習済みパラメータ)がダウンロード可能であり、自社インフラ上でホスティング・推論処理を実行できることを意味します。

「オープンウェイト」と「オープンソース」は厳密には異なる概念です。オープンソースは学習コード・データセット・訓練手法すべての公開を含みますが、オープンウェイトはモデルの重みのみを公開し、学習の詳細は非公開の場合があります。DeepSeekは過去のモデルでも学習手法の一部を論文で公開しており、透明性の高いアプローチを取っています。

詳細解説:ベンチマーク結果と技術的優位性

LiveCodeBenchでの圧倒的スコア

DeepSeek-V4-Proは、リアルタイムコーディング能力を測定する「LiveCodeBench」においてPass@1スコア93.5%を記録しました。

| モデル | LiveCodeBench Pass@1 |

|---|---|

| DeepSeek-V4-Pro | 93.5% |

| Claude Opus 4.6 | 88.8% |

| GPT-5.5 Pro | 非公開(推定同等水準) |

Pass@1とは「1回の試行で正解コードを生成できる確率」を意味します。93.5%という数字は、ほぼすべてのコーディングタスクで正確なコードを一発で生成できることを示しており、これは熟練したソフトウェアエンジニアに匹敵する水準です。

SWE-benchでの実績

ソフトウェアエンジニアリングの総合的な能力を測定する「SWE-bench」においても、DeepSeek-V4は高いスコアを記録しています。SWE-benchは、実際のGitHubリポジトリからの課題を解決する能力を評価するもので、単なるコード生成ではなく、問題理解・設計・実装・テストという開発プロセス全体の能力が試されます。

100万トークンコンテキストの意味

100万トークンのコンテキスト長は、実用上以下のようなユースケースを可能にします。

- 大規模コードベース全体の理解:数十万行のコードベースを一度に入力し、アーキテクチャを理解した上で修正提案を受ける

- 長編文書の処理:書籍1冊分の内容を入力して要約・分析・質問応答を行う

- 複数文書の横断分析:数十の契約書・レポートを同時に入力して比較分析を行う

Claude Opus 4.6のコンテキスト長は200Kトークン(20万トークン)であり、DeepSeek-V4はその5倍の容量を処理できます。

コスト効率:フロンティアの1/6

DeepSeekの最も破壊的な特徴は、そのコスト構造にあります。DeepSeek-V4は、GPT-5.5やClaude Opus 4.7といった主要フロンティアクローズドモデルの約6分の1のコストで利用可能とされています。

| 項目 | フロンティアクローズドモデル | DeepSeek-V4 |

|---|---|---|

| API利用コスト(相対比) | 1.0 | 約0.17 |

| 推論速度 | 高速 | 同等〜やや低速 |

| カスタマイズ性 | API経由のみ | オンプレミス可能 |

このコスト効率は、MoE(Mixture of Experts)アーキテクチャの採用と、効率的な学習手法によって実現されています。MoEは、入力に応じて一部の「専門家」モジュールのみを活性化させることで、モデル全体のパラメータ数が大きくても実際の計算量を抑える技術です。

業界への影響:オープンモデル時代の到来

クローズドvsオープンの力学変化

2024年〜2025年前半まで、AI基盤モデル市場は「最先端性能はクローズドモデルの独占領域」という構図でした。OpenAIのGPTシリーズ、AnthropicのClaude、GoogleのGeminiといったクローズドモデルがベンチマークの上位を占め、オープンモデル(Meta Llama等)は「コスト重視の代替選択肢」という位置付けでした。

DeepSeek-V4の登場は、この力学を根本から変えます。オープンウェイトモデルがフロンティアクローズドモデルを性能で上回ったことで、「最先端性能が必要ならクローズド」という前提が崩れました。

クラウドベンダーへの影響

OpenAI、Anthropic、Googleといったクローズドモデルプロバイダーは、APIアクセス料金を主要な収益源としています。DeepSeek-V4のようなオープンウェイトモデルが同等性能を1/6のコストで提供できるとなると、価格競争圧力が強まります。

特に、大量のAPI呼び出しを行うエンタープライズ顧客にとって、DeepSeekを自社インフラまたはAWSやGCP上でホスティングするコストと、Claude/GPT APIの利用料金を比較検討する動きが加速するでしょう。

中国AI産業の台頭

DeepSeekは、中国のクオンツファンドHigh-Flyer Capital Managementから派生した企業です。2026年1月にDeepSeek-V3.2(DeepSeek R1)でフロンティア級性能をオープンソースで実現し、世界に衝撃を与えました。今回のV4は、その路線をさらに推し進めたものです。

米国の半導体輸出規制(NVIDIA A100/H100の中国向け輸出禁止等)にもかかわらず、DeepSeekが最先端性能を実現し続けていることは、中国AI産業の技術的底力を示しています。

日本企業への示唆:オンプレミスAIの現実的選択肢

データ主権問題への解答

日本の製造業・金融・医療機関の多くは、データを外部クラウドに送信することに慎重です。機密性の高い設計図面、顧客金融情報、患者医療記録などをAPI経由で外部に送信することは、セキュリティポリシー上許容されないケースが多くあります。

DeepSeek-V4のオープンウェイト公開は、この問題に対する解答を提供します。自社データセンターまたは国内クラウド(さくらインターネット、IIJ、NTTデータ等)上でDeepSeek-V4をホスティングすれば、データは外部に出ることなく、フロンティア級の性能を活用できます。

コスト構造の変革

AI導入の障壁として「APIコストの予測困難性」がしばしば挙げられます。利用量に応じて課金されるAPIモデルでは、全社展開時のコストが読みにくく、ROI計算が困難になります。

オンプレミスホスティングの場合、初期のインフラ投資(GPU/NPUサーバー)と運用コスト(電力、管理)が主要コストとなり、利用量に対してほぼ固定費となります。大量利用する場合、API課金よりも総コストが低くなる閾値が存在します。

導入検討のポイント

ハードウェア要件

DeepSeek-V4-Proをローカルで動作させるには、以下のようなハードウェアが必要と推測されます(公式要件は公開情報を確認してください)。

- NVIDIA A100/H100/H200クラスのGPU複数台

- 大容量VRAM(80GB以上/GPU)

- 高速ストレージ(NVMe SSD)

- 十分なシステムメモリ

軽量版の選択肢

DeepSeek-V4-Flashは、V4-Proよりも軽量なモデルとして設計されており、より少ないリソースで動作可能です。全社展開の初期段階ではFlashを採用し、高度なタスクにのみProを使用するハイブリッド構成も検討に値します。

ファインチューニングの可能性

オープンウェイトモデルの利点の一つは、自社データでファインチューニング(追加学習)できることです。製造業の設計ドキュメント、金融機関の社内規定、医療機関の診療ガイドラインなど、業界特有のデータで学習させることで、汎用モデル以上の精度を特定タスクで実現できます。

今後の展望:オープンAI時代の競争

DeepSeekの次のステップ

DeepSeek-V4は「Preview」として公開されており、正式版リリースに向けてさらなる改善が予想されます。また、DeepSeekはマルチモーダル(画像・動画対応)や、より長いコンテキスト対応(200万トークン以上)といった拡張も視野に入れていると考えられます。

クローズドモデル陣営の対応

OpenAI、Anthropic、Googleは、DeepSeek-V4の登場を受けて価格戦略の見直しを迫られる可能性があります。また、「クローズドだからこそ提供できる付加価値」(安全性保証、エンタープライズサポート、コンプライアンス対応等)を強調する戦略にシフトすることも考えられます。

規制環境の影響

米中間のAI関連規制がどう推移するかも、DeepSeekの利用可能性に影響を与えます。現時点では日本企業がDeepSeekを利用することに法的障壁はありませんが、地政学的状況の変化によってはリスク評価が必要になる可能性があります。

AI COMMONでは、AI最新動向を踏まえた戦略立案から実装まで、お客様のビジネスに最適なAI活用をトータルでサポートしています。 オンプレミスAI導入、オープンモデルの評価・検証についてご検討の方は、ぜひお気軽にご相談ください。

関連記事

- 週間AIニュース(2026年04月27日週)- GoogleのAnthropicへ最大400億ドル投資とDeepSeek-V4が塗り替えるAI勢力図

- DeepSeek R2技術解説:MoEアーキテクチャとオープンソースAI競争の新局面

参考文献

-

DeepSeek「DeepSeek API Documentation」(2026年4月閲覧)

https://api-docs.deepseek.com/ -

DeepSeek「DeepSeek 公式 GitHub Organization」(2026年4月閲覧)

https://github.com/deepseek-ai -

Hugging Face「deepseek-ai モデル一覧(公式)」(2026年4月閲覧)

https://huggingface.co/deepseek-ai -

arXiv「DeepSeek-V3 Technical Report」(2024年)

https://arxiv.org/abs/2412.19437 -

SWE-bench「SWE-bench 公式リーダーボード」(2026年4月閲覧)

https://www.swebench.com/

📢この記事をシェアしませんか?

おすすめの投稿:

DeepSeek-V4がLiveCodeBench Pass@1 93.5%でClaude Opus 4.6を上回る——フロンティアモデルの1/6コストでオープンウェイト公開。オープンモデルがクローズドを超える時代が到来

引用しやすいフレーズ:

“DeepSeek-V4-ProがLiveCodeBench Pass@1 93.5%を記録——Claude Opus 4.6の88.8%を超え、オープンモデルがフロンティアを上回る新時代”

“フロンティアクローズドモデルの1/6コストで100万トークン対応——コスト効率革命がAI市場の構造を変える”

“オープンウェイト公開でオンプレミス利用可能——データ主権を重視する日本企業に新たな選択肢”