OpenAI ChatGPT Health発表 - ヘルスケアAI市場1兆ドルへの号砲

この記事は週間AIニュース(2026年1月12日週)の詳細版です。

OpenAI、医療業界への本格参入を宣言

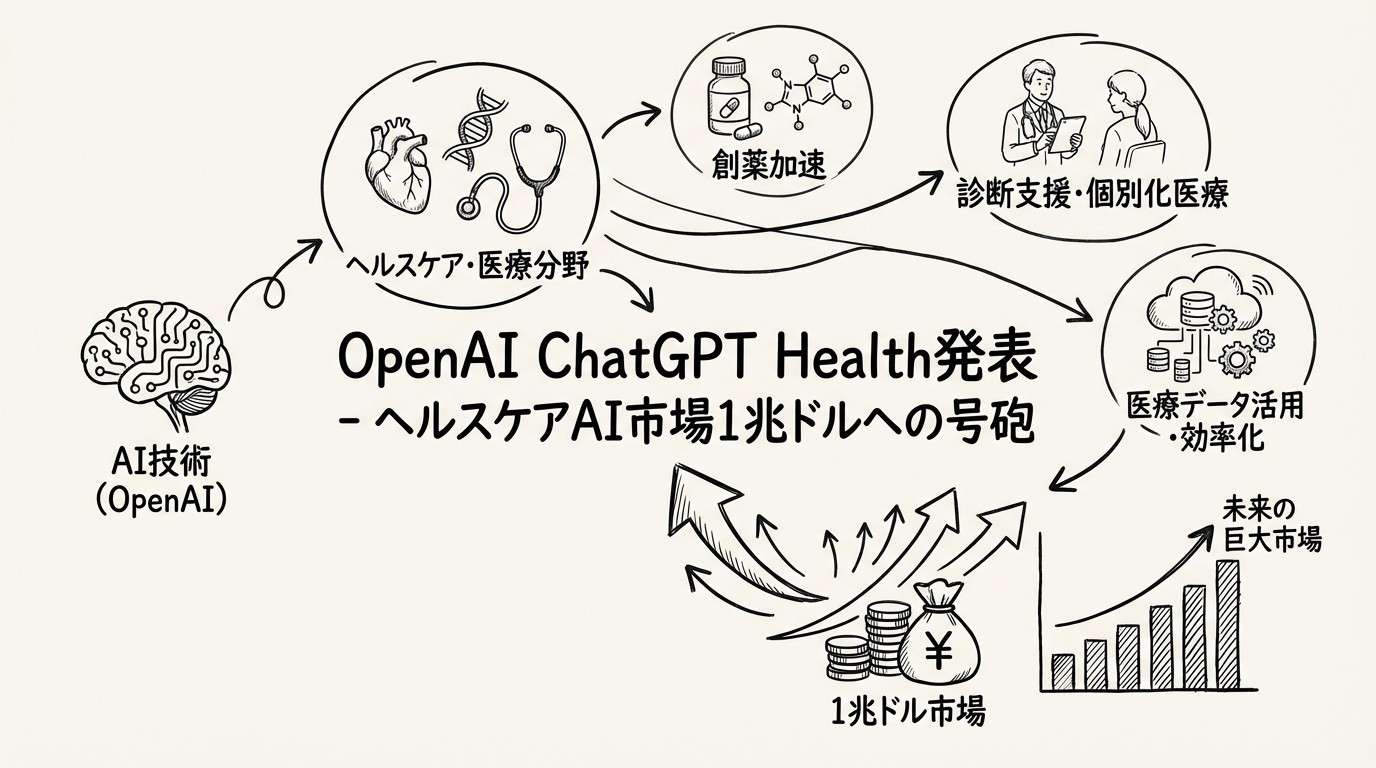

2026年1月、OpenAIは医療専門家と患者を支援するヘルスケア特化型サービス「ChatGPT Health」を正式に発表しました。これは、OpenAIが特定の業界向けに垂直統合されたソリューションを提供する初の事例であり、同社が「汎用AI」から「業界特化AI」へと戦略を転換する象徴的な動きです。

ChatGPT Healthは、米国の医療情報プライバシー法(HIPAA)に完全準拠し、電子カルテ(EMR)システムとのAPI連携により、診察記録の自動作成や診断支援を提供します。OpenAIのCEOサム・アルトマン氏は、「医療は人類にとって最も重要な分野の一つであり、AIが最も大きな貢献をできる領域」と述べています。

本記事では、ChatGPT Healthの技術的特徴、世界のヘルスケアAI市場の動向、主要競合との比較、そして日本の医療業界への影響を徹底的に解説します。

ChatGPT Healthの技術的特徴

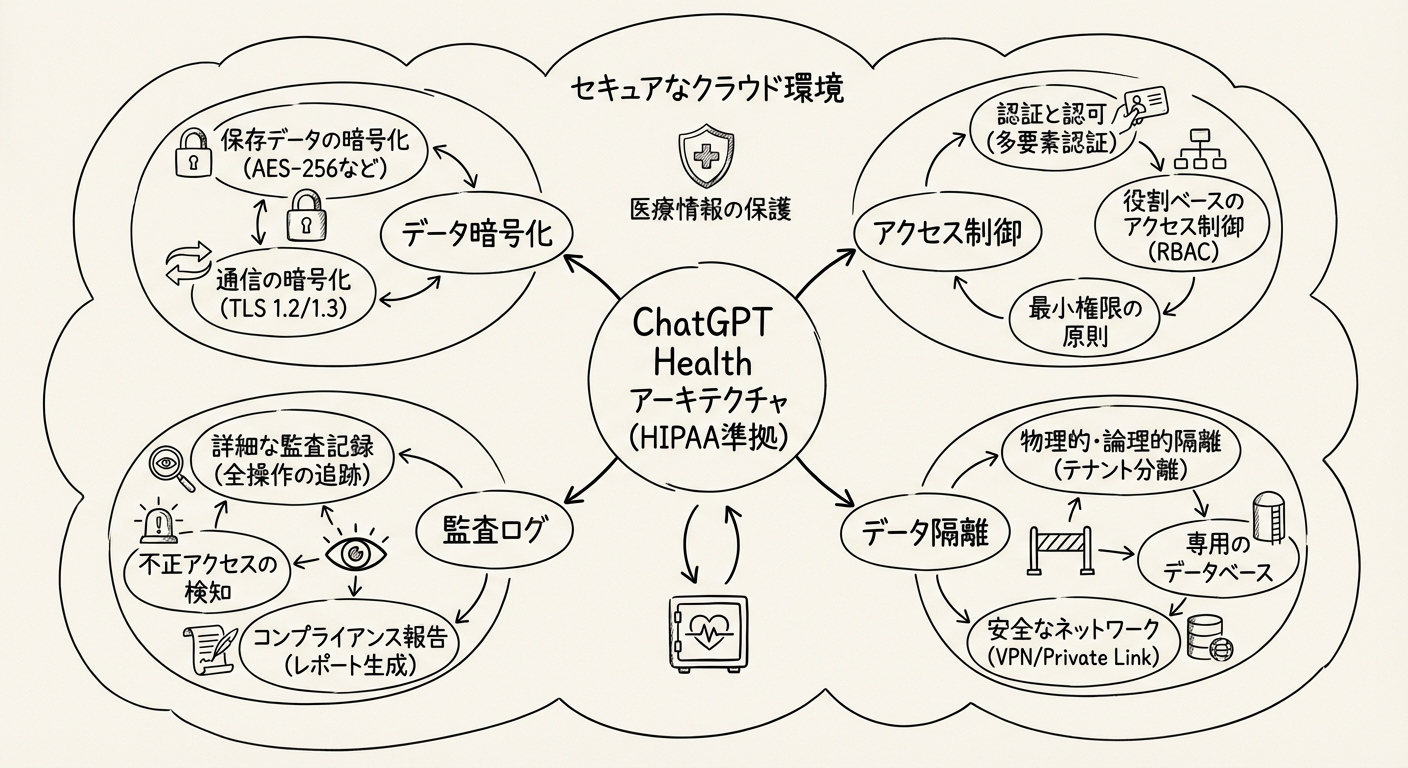

1. HIPAA準拠とデータ保護の徹底

米国の医療業界では、患者の健康情報(PHI: Protected Health Information)を扱うすべてのシステムが、HIPAA(Health Insurance Portability and Accountability Act)に準拠する必要があります。ChatGPT Healthは、以下の方法でHIPAAコンプライアンスを実現しています。

図1: ChatGPT HealthのHIPAA準拠アーキテクチャ

技術的実装:

- データ暗号化: 転送中(TLS 1.3)および保存時(AES-256)の暗号化

- アクセス制御: ロールベースのアクセス制御(RBAC)と多要素認証(MFA)

- 監査ログ: すべてのアクセスと操作を記録し、不正利用を検知

- データ隔離: 医療データは他のChatGPTユーザーデータと完全に分離された環境で処理

- BAA(Business Associate Agreement): OpenAIは医療機関とBAAを締結し、法的責任を明確化

重要な制約:

標準のChatGPT(無料版やPlus)はHIPAA非準拠です。ChatGPT HealthまたはChatGPT Enterprise with BAAのみが、医療情報の処理に使用できます。また、ユーザーの入力データはモデルの学習には一切使用されないことが保証されています。

2. EMR(電子医療記録)連携

ChatGPT Healthは、サードパーティのプラットフォーム(例:b.well)を介して、多数の医療機関のEMRシステムと安全に接続します。

主要な連携機能:

- 診察記録の自動生成: 医師と患者の会話を音声認識し、カルテとして構造化(アンビエント診療)

- 過去の診療履歴の参照: 患者の既往歴、投薬履歴、アレルギー情報などを瞬時に検索

- 診断支援: 症状と検査結果から、鑑別診断の候補を提示(最終判断は医師が行う)

- 個別化された患者教育: 患者の医療記録に基づき、理解しやすい言葉で病状や治療法を説明

対応EMRシステム:

Epic、Cerner、Allscripts、Athenahealth、NextGen Healthcareなど、米国の主要EMRシステムとの連携が可能です。日本のEMRシステム(電子カルテ3大ベンダー: 富士通、NECなど)との連携は、今後の展開次第となります。

3. 専門モデルとエビデンスベースの回答

ChatGPT Healthは、汎用のChatGPTとは異なり、信頼性の高い医学情報源に基づいて追加学習された専門モデルを使用しています。

学習データ:

- PubMed(米国国立医学図書館の医学論文データベース)

- UpToDate(エビデンスに基づく臨床意思決定支援ツール)

- 各種診療ガイドライン(米国内科学会、米国心臓協会など)

- FDA承認薬の添付文書

出典の明記:

重要な点として、ChatGPT Healthは回答に出典(引用文献)を明記します。これにより、医師は回答の根拠を確認でき、AIの「幻覚(ハルシネーション)」による誤情報のリスクを低減します。

4. セキュリティインフラ

ChatGPT Healthは、以下のセキュリティ対策を実装しています。

- ゼロトラストアーキテクチャ: すべてのアクセスを検証し、最小権限の原則を適用

- 定期的なセキュリティ監査: 第三者機関によるペネトレーションテストと脆弱性診断

- インシデント対応計画: データ漏洩時の通知手順と復旧プロセスを整備

- オンプレミス展開オプション: 大規模医療機関向けに、自社データセンター内での運用も可能

ヘルスケアAI市場の爆発的成長

世界市場の予測

ヘルスケアAI市場は、過去数年で最も急成長しているAI応用分野の一つです。複数の市場調査機関による予測を統合すると、以下の成長が見込まれます。

| 年 | 市場規模 | 備考 |

|---|---|---|

| 2024年 | 150億〜270億ドル | 推定値(調査機関により幅あり) |

| 2026年 | 300億〜400億ドル | 年平均成長率(CAGR)30%〜50% |

| 2030年 | 1,000億ドル超 | 中期予測 |

| 2034年 | 最大1兆ドル | Fortune Business Insights予測 |

表1: ヘルスケアAI市場規模の予測

この驚異的な成長を牽引する要因は、以下の通りです。

1. 医療データの爆発的増加

医療画像(CT、MRI、病理スライド)、ゲノムデータ、ウェアラブルデバイスからのバイタルサインなど、医療データは年間48%の割合で増加しています。これらのビッグデータを人間が処理することは不可能であり、AI活用が不可欠です。

2. 高齢化と慢性疾患の増大

世界的な高齢化により、糖尿病、心疾患、がんなどの慢性疾患患者が急増しています。これらの管理には継続的なモニタリングと個別化された治療が必要であり、AIによる支援が期待されています。

3. 医療現場の効率化ニーズ

米国では、医師が診療記録の作成に1日平均2時間以上を費やしており、これが医師の燃え尽き症候群(バーンアウト)の主要因となっています。AIによる文書作成の自動化は、医師の本来の業務(患者ケア)への集中を可能にします。

4. AI技術の進化

大規模言語モデル(LLM)の登場により、医学文献の理解、診断推論、患者とのコミュニケーションなど、従来は人間の医師にしかできなかった高度なタスクが、AIでも可能になりつつあります。

主要応用分野

ヘルスケアAI市場は、以下の分野で特に成長が著しいです。

診断支援(Diagnostics):

- 医療画像診断(X線、CT、MRI、病理スライド)における病変の検出

- 放射線科医や病理医の負担軽減と診断精度の向上

- 市場シェア: 約25%

創薬開発(Drug Discovery):

- AIによる新薬候補物質の探索(従来数年かかっていたプロセスを数ヶ月に短縮)

- 臨床試験の最適化(適切な患者の選定、副作用の予測)

- 市場シェア: 約20%

個別化医療(Personalized Medicine):

- ゲノム情報に基づく個別化された治療法の選択

- がん治療における最適な薬剤の選定

- 市場シェア: 約15%

手術支援ロボット:

- da Vinciなどの手術支援ロボットへのAI統合

- 術中のリアルタイム意思決定支援

- 市場シェア: 約10%

ヘルスケアマネジメント:

- 病院の運営効率化(患者の流れの最適化、スタッフ配置の自動化)

- 保険会社の請求処理の自動化

- 市場シェア: 約15%

その他(リモート診療、メンタルヘルス、健康管理アプリ等):

- 市場シェア: 約15%

地域別動向

北米:

現在の市場リーダー。強力なヘルスケアインフラ、豊富な投資資金、規制環境の整備(HIPAA、FDA承認プロセス)が整っています。2024年時点で世界市場の約40%を占めます。

アジア太平洋:

最も高い成長率(CAGR 50%超)が予測される地域。特に中国、インド、日本での政府主導のデジタルヘルス推進が背景にあります。ただし、規制環境やデータ保護の整備が課題です。

ヨーロッパ:

GDPR(一般データ保護規則)により、プライバシー保護が最も厳格な地域。AI開発においてはデータアクセスの制約がありますが、倫理的なAI開発のモデルケースとなっています。

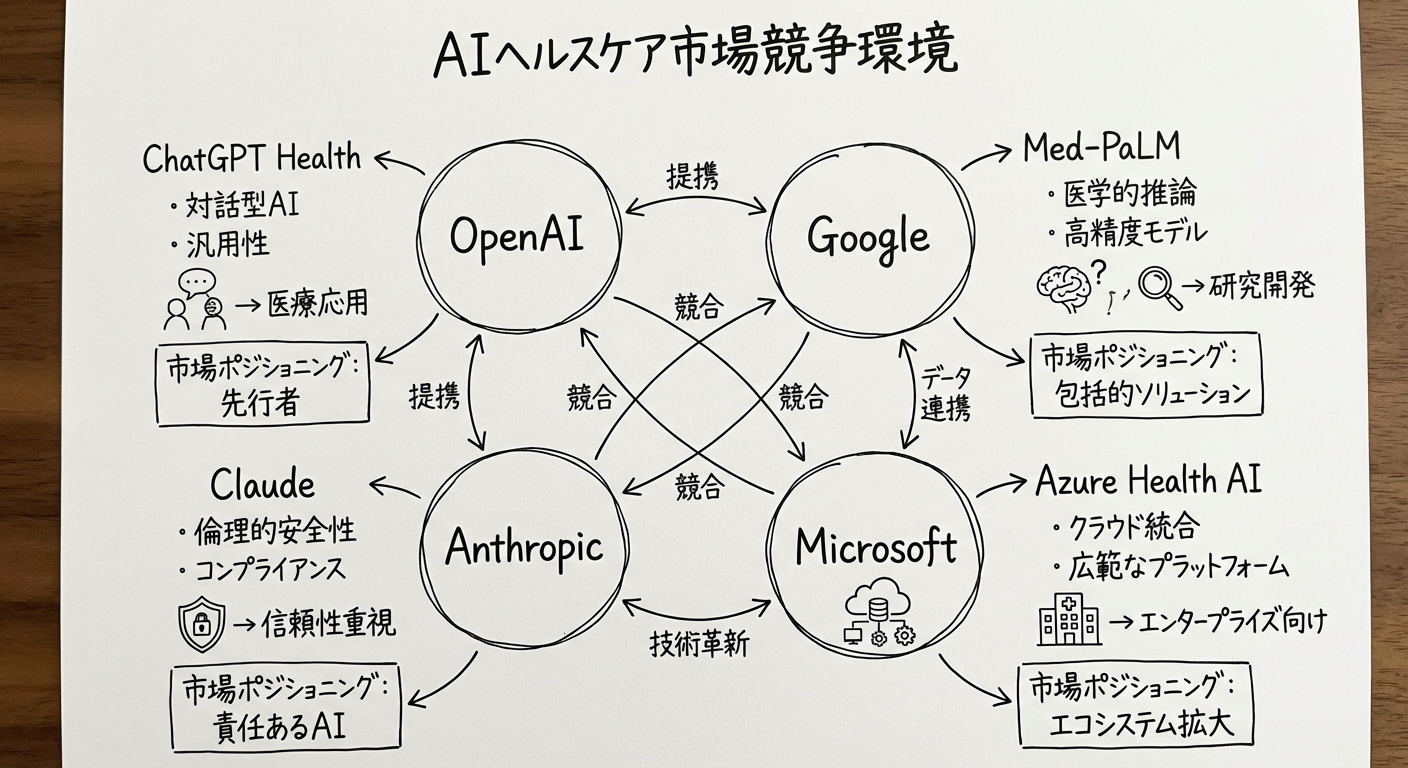

主要競合の動向

ChatGPT Healthは、すでに激しい競争が繰り広げられているヘルスケアAI市場に参入します。主要な競合プレイヤーを比較します。

1. Google Med-PaLM / MedLM

技術的特徴:

- 医療に特化したLLM(Med-PaLM 2)は、米国の医師国家試験(USMLE)で専門医レベルの正答率(85%超)を記録

- 画像、ゲノム、電子カルテデータを統合して解析できるマルチモーダル性が強み

- 「MedLM」として商用提供を開始(Google Cloud経由)

強み:

- Google Healthの長年の研究実績(DeepMindのAlphaFoldなど)

- Google Cloudの強力なインフラと顧客基盤

- 医療画像診断AIでの実績(網膜症の早期発見など)

弱み:

- 汎用LLMとの差別化が不明確

- 医療機関との直接的なパートナーシップはOpenAIより少ない

2. Anthropic (Claude)

技術的特徴:

- AIの安全性と倫理性を最重視する「Constitutional AI」アプローチ

- 汎用モデル(Claude)をHIPAA準拠の環境で提供

- 医療分野専用のファインチューニングは限定的

強み:

- 「幻覚」の発生率が低く、信頼性が高い

- プライバシー保護への強いコミットメント(データ学習への不使用を保証)

- 医療分野のリスク低減を重視する機関にとって魅力的

弱み:

- 医療専用の機能(EMR連携など)が不足

- 市場シェアはOpenAIに比べて小さい

3. Microsoft Azure Health AI

技術的特徴:

- Azureプラットフォーム上で多様な医療向けAIサービス・ツール群を提供

- OpenAIモデル(GPT-4など)も活用可能

- 電子カルテ大手Epic Systems、Cerner(現Oracle Health)との強力な連携

強み:

- 既存の強力な顧客基盤(多くの病院がAzureを利用)

- エンタープライズ向けのセキュリティとコンプライアンス実績

- 医療業界への深い理解と長年のパートナーシップ

弱み:

- 自社開発の医療専用LLMは持たず、OpenAIモデルに依存

- ユーザーインターフェースの使いやすさではOpenAIに劣る可能性

4. 新興プレイヤー

- Hippocratic AI: 医療専用の「安全第一」LLMを開発。看護師の負担軽減に特化

- Nabla: フランス発のAI医療アシスタント。欧州市場で急成長

- 日本勢: Preferred Networks、エルピクセル、アイリスなどが医療画像診断AIで実績

図2: ヘルスケアAI市場の主要プレイヤー

医療機関での導入事例と効果

すでにOpenAIの医療向けAIサービス(ChatGPT EnterpriseやAPI)を導入している医療機関から、具体的な成果が報告されています。

Mayo Clinic(メイヨー・クリニック)

世界有数の医療機関であるMayo Clinicは、AIを活用した精密医療(Precision Medicine)を推進しています。

- 疾患リスク予測: 患者のゲノムデータ、臨床データ、生活習慣データを統合し、将来の疾患リスクを予測

- 効果: 心血管疾患の早期介入により、入院率を15%低減

- 技術: Azure上でOpenAIモデルを活用

Kaiser Permanente(カイザー・パーマネンテ)

米国最大級の統合型医療システムであるKaiser Permanenteは、AIによる予防医療を強化しています。

- 慢性疾患管理: 糖尿病患者のモニタリングとパーソナライズされた介入プログラム

- 効果: 患者のHbA1c(血糖コントロール指標)を平均0.8%改善

- 技術: 自社開発AIとOpenAI APIの組み合わせ

TidalHealth(タイダルヘルス)

中規模病院であるTidalHealthは、医師の業務効率化にAIを活用しています。

- 臨床情報検索: 患者の過去の検査結果、投薬履歴、診療記録を自然言語で検索

- 効果: 検索時間を平均80%短縮(従来15分 → 3分)

- 技術: ChatGPT Enterprise with BAA

Penda Health(ペンダ・ヘルス、ケニア)

アフリカの医療アクセス向上に取り組むPenda Healthは、AIによる診断支援を導入しています。

- 診断エラーの低減: 経験の浅い医療従事者がAI支援により、より正確な診断を実現

- 効果: 誤診率を30%低減

- 技術: OpenAI API(低コストの小型モデル)

Valley Medical Center(バレー・メディカルセンター)

病院経営の効率化にAIを活用しています。

- スタッフ配置の最適化: 患者の流れを予測し、適切な人員配置を自動提案

- 効果: 待ち時間を平均25%短縮、スタッフの残業を20%削減

- 技術: Azure AI + OpenAI

プライバシーとセキュリティの課題

ヘルスケアAIの最大の懸念は、患者の機微な個人情報(PHI)を扱うことによるプライバシーリスクです。

主要なリスク

1. データ漏洩

- 医療データは闇市場で高額で取引されるため、サイバー攻撃の標的になりやすい

- 2024年には、米国の医療機関の60%以上がランサムウェア攻撃を経験

2. 不正アクセス

- 内部関係者(従業員、委託業者)による不正なデータアクセス

- アクセス権限の管理不備

3. 再識別化リスク

- 匿名化されたデータでも、他のデータと組み合わせることで個人を特定できるリスク

- ゲノムデータは本質的に個人を識別できる

4. AIの「幻覚」による誤情報

- AIが事実でない情報を生成し、それが医療判断に影響するリスク

- 特に希少疾患や最新の治療法に関する情報で発生しやすい

対策とベストプラクティス

技術的対策:

- エンドツーエンドの暗号化

- ゼロトラストアーキテクチャ

- 定期的なセキュリティ監査とペネトレーションテスト

- AIの出力に対する人間(医師)の最終確認

組織的対策:

- スタッフへのプライバシー教育

- インシデント対応計画の整備

- 第三者認証の取得(HITRUST、ISO 27001など)

規制遵守:

- HIPAA(米国)、GDPR(EU)、個人情報保護法(日本)などへの準拠

- AIベンダーとのBAAまたはDPA(Data Processing Agreement)の締結

日本の医療業界への影響

ChatGPT Healthは現時点では米国市場を中心に展開されていますが、日本の医療業界にも大きな影響を与えることが予想されます。

1. 電子カルテメーカーへの脅威と機会

日本の電子カルテ市場:

- 富士通、NEC、ソフトウェア・サービス(SS-MIX2)などが主要プレイヤー

- 市場規模: 約2,000億円(2024年)

脅威:

- OpenAI、Microsoft、Googleなどのグローバル企業がAPI経由で直接医療機関にサービスを提供する場合、既存の電子カルテメーカーは「データの通り道」に過ぎなくなるリスク

- 付加価値の源泉を失い、価格競争に巻き込まれる

機会:

- 既存の電子カルテシステムにAI機能を搭載し、付加価値を向上

- 日本の医療制度(診療報酬体系、レセプトシステム)に最適化されたAI機能は、グローバル企業では提供困難

- OpenAIやGoogleとのパートナーシップにより、最新技術を自社製品に統合

実際の動き:

- 富士通は、Microsoft Azureと連携し、電子カルテにAI機能を搭載する計画を発表(2025年12月)

- NECは、独自の医療AI「NEC Medical AI」を開発中

2. 製薬企業の創薬プロセス変革

日本の製薬企業(武田薬品、アステラス製薬、第一三共など)は、AIによる創薬研究を加速しています。

具体的な応用:

- 創薬標的の探索: 疾患に関連する遺伝子やタンパク質をAIで特定

- 化合物のスクリーニング: 数百万の化合物から、効果が期待できるものをAIで選別

- 臨床試験の最適化: 適切な患者の選定、副作用の予測

効果:

- 創薬期間を従来の10年以上から5年程度に短縮

- 開発コストを数千億円から数百億円に削減

- 希少疾患など、従来は採算が取れなかった分野への参入が可能に

OpenAIの役割:

- 医学文献の自動分析(PubMedの数百万の論文を瞬時に検索・要約)

- 研究者の仮説生成支援

- 臨床試験データの解析

3. 医療機関の働き方改革

日本の医師の労働時間は国際的にも長く、2024年の「医師の働き方改革」により、時間外労働の上限規制が導入されました。

AIによる支援:

- 診療記録作成の自動化: 医師と患者の会話を音声認識し、カルテを自動作成

- 効果: 1日2時間以上かかっていた記録作業を30分以下に短縮

- 実装の障壁: 日本語の医療用語(カルテ記載)への対応、音声認識の精度

患者への影響:

- 医師が記録作業ではなく、患者との対話に時間を割けるようになる

- より質の高い医療サービスの提供

導入コストと格差:

- 大学病院や大規模病院は導入可能だが、中小病院や地方の診療所には費用負担が重い

- 医療の地域格差が拡大するリスク

4. 患者の医療参加の促進

ChatGPT Healthのような患者向けAIサービスは、「患者中心の医療」を促進します。

具体的な機能:

- 自身の症状について、信頼できる医療情報を簡単に検索

- 処方された薬の効果や副作用を理解

- セカンドオピニオンを得るための情報収集

日本での課題:

- 日本語での医療情報の質と量(英語に比べて不足)

- 患者が誤った情報に基づいて自己判断するリスク(「Dr. Google」問題の拡大)

- 医師と患者の信頼関係への影響

日本の規制対応

ChatGPT Healthのような医療AIを日本で展開する場合、以下の法規制への対応が必要です。

1. 医師法

AIはあくまで「支援ツール」であり、診断・治療の最終的な判断と責任は医師が負う必要があります。

- 第17条: 医師でなければ、医業をなしてはならない

- 解釈: AIが診断や治療方針を決定することは「医行為」に該当し、違法となる

- 許容される範囲: AIが情報提供や候補の提示を行い、医師が最終判断する形であれば許容される

医療機器としての承認:

- AIが診断等を行う場合(例:画像診断AIが「がんである」と判定)、薬機法に基づく「医療機器」としての承認が必要

- 承認プロセス: PMDA(医薬品医療機器総合機構)による審査

- ChatGPT Healthが日本で展開する場合、この承認を取得するかどうかが焦点

2. 個人情報保護法

医療情報は「要配慮個人情報」であり、その取り扱いには本人の明確な同意が原則必要です。

- 第20条: 要配慮個人情報の取得には本人の同意が必要

- 第28条: 外国にある第三者への提供には本人の同意が必要

ChatGPT Healthの課題:

- OpenAIのサーバーが米国にある場合、日本の患者データを米国に転送することになる

- これは「個人データの越境移転」に該当し、患者の明示的な同意と、転送先の安全管理措置の説明が必要

- 2026年の法改正: 政府が個人情報保護法の改正案を提出(AI学習目的での利用を緩和)しており、これが医療データにどう適用されるかが注目される

3. ガイドラインと自主規制

厚生労働省は、医療現場でのAI利用に関するガイドラインを公表しています。

- 「保健医療分野におけるAI活用推進懇談会」報告書(2019年)

- 「医療機器プログラムの承認申請に関するガイダンス」(2022年改訂)

推奨される対応:

- 入力データが再学習に利用されない設定の確認

- AI出力の根拠(引用文献)の確認

- AIに過度に依存せず、医師の臨床判断を最優先

医療AI プラットフォーム技術研究組合(HAIP):

- 産学官が連携し、医療AIの品質・安全性の標準化を推進

- 国際標準(ISO/IEC)への対応も進行中

今後の展望と課題

展望: 医療のパラダイムシフト

1. 超個別化医療の実現

- 患者一人ひとりのゲノム、生活習慣、環境要因に基づいた完全にカスタマイズされた治療

- がん治療における「オーダーメイド医療」が標準となる

2. 医療の民主化

- 地理的・経済的な制約を超えて、世界中の誰もが質の高い医療情報にアクセス可能に

- 発展途上国での医療アクセス向上

3. 創薬研究の加速

- AI活用により、従来は10年以上かかっていた新薬開発が5年以下に短縮

- 希少疾患など、患者数が少ない疾患への治療法開発が進む

4. アンビエント診療の普及

- 医師と患者の会話から自動でカルテが生成される「アンビエント診療」が標準化

- 医師は患者との対話に集中でき、医療の質が向上

課題: 技術的・倫理的・法制度的

1. AIの「幻覚」による誤情報リスク

- 特に希少疾患や最新の治療法に関する情報で発生しやすい

- 対策: 出典の明記、医師の最終確認、継続的なモデルの改善

2. 医療過誤時の責任所在

- AIの提案に基づいて医師が判断し、結果として患者に害が生じた場合、責任は誰にあるのか

- 法的枠組みの整備が急務

3. 医療データの標準化の遅れ

- 日本の医療機関間でデータ形式が統一されておらず、AI活用の障壁となっている

- 政府主導での標準化(SS-MIX2の普及など)が必要

4. 医療の非人間化への懸念

- AIに過度に依存することで、医師と患者の人間的な関係が希薄化するリスク

- 「患者を診る」のではなく「データを診る」医療になる懸念

5. 導入コストと格差問題

- 大病院と中小病院、都市部と地方での医療格差が拡大するリスク

- 公的支援や低コストのAIソリューションの提供が必要

6. 倫理的ジレンマ

- AIがリソース配分の優先順位を決定する場合(トリアージ)、倫理的に許容されるのか

- 患者のプライバシーと公衆衛生(感染症対策など)のバランス

まとめ

OpenAIのChatGPT Health発表は、ヘルスケアAI市場における大きな転換点です。2034年に1兆ドル規模に達すると予測されるこの市場で、OpenAI、Google、Microsoft、Anthropicなどのテック巨人が激しい競争を繰り広げています。

日本の医療業界にとって、これは脅威であると同時に大きな機会でもあります。電子カルテメーカーは既存システムへのAI統合により付加価値を高め、製薬企業は創薬プロセスを劇的に効率化し、医療機関は働き方改革と医療の質向上を両立できる可能性があります。

しかし、医師法、個人情報保護法、薬機法などの規制対応、プライバシー保護、AIの信頼性確保、医療格差の拡大防止など、乗り越えるべき課題も山積しています。2026年は、これらの課題を社会全体で議論し、技術の恩恵を最大化しつつリスクを最小化するための重要な年となるでしょう。

AI COMMONでは、お客様のビジネスに最適なAIソリューションの導入をトータルでサポートしています。 ヘルスケアAIの導入、規制対応、データプライバシー保護など、ご検討の方は、ぜひお気軽にご相談ください。

関連記事

- 週間AIニュース(2026年1月12日週)- エージェントAIと規制の時代へ

- 2026年、汎用AIから専門AIへ — ドメイン特化モデルが変える企業戦略

- 2026年AIガバナンスと規制強化:企業に求められる対応と準備

参考文献

- OpenAI公式サイト - ChatGPT Health発表資料

- HIPAA Journal - "OpenAI and HIPAA Compliance"

- Fierce Healthcare - "Healthcare AI Market Trends 2026"

- MarketsandMarkets - "Healthcare AI Market Research Report 2024-2034"

- Grand View Research - "Healthcare Artificial Intelligence Market Analysis"

- Fortune Business Insights - "Healthcare AI Market Size and Forecast"

- Healthcare IT News - "OpenAI Customer Stories in Healthcare"

- 米国国立衛生研究所(NIH) - "AI in Healthcare: Privacy and Security Considerations"

- Foley & Lardner LLP - "Legal Issues in Healthcare AI"

- 日経メディカル - "日本の医療AI市場動向"

- 厚生労働省 - "保健医療分野におけるAI活用推進懇談会報告書"

- 医療AIプラットフォーム技術研究組合(HAIP) - "医療AIの品質・安全性に関するガイドライン"