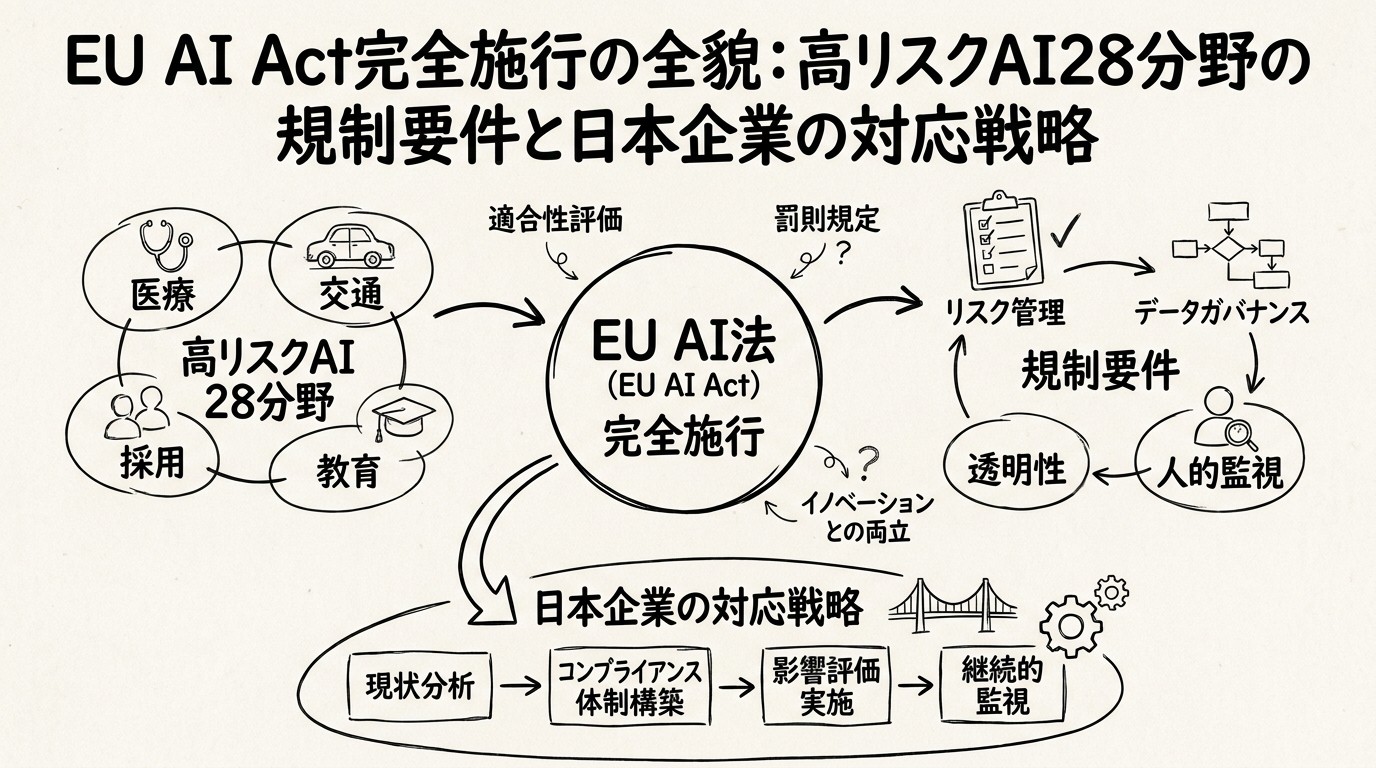

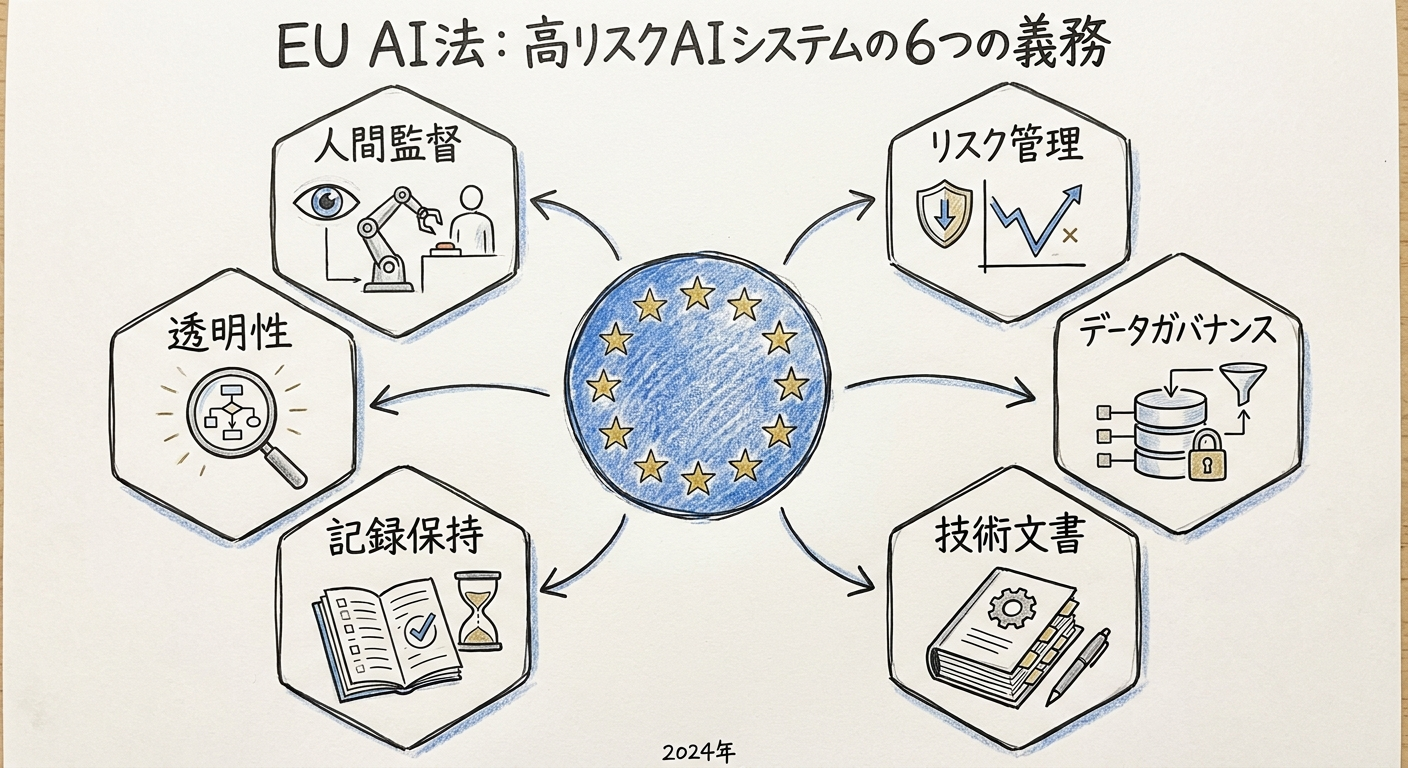

EU AI Act完全施行の全貌:高リスクAI28分野の規制要件と日本企業の対応戦略

この記事は週間AIニュース(2026年04月20日週)の詳細版です。

2026年4月21日、AI業界にとって歴史的な転換点が訪れました。EU AI Act(人工知能法)の高リスクAIシステムに関する規定が完全施行され、医療診断・採用・信用スコアリングなど28分野のAIシステムに対して、厳格な法的義務が発効したのです。2024年8月の発効から段階的に適用が進んできた同法は、この日をもって全ての主要条項が法的拘束力を持つこととなりました。

EU AI Actは、AIの「リスクベース」アプローチを採用した世界初の包括的AI規制法です。AIシステムをリスクレベルに応じて4段階に分類し、高リスクなAIほど厳格な要件を課す設計となっています。この枠組みは、GDPRが個人データ保護のグローバルスタンダードとなったように、AI規制の世界標準を確立するものとして注目されています。

本記事では、EU AI Act完全施行の詳細な内容、高リスクAI28分野の具体的な規制要件、そして日本企業がとるべき対応戦略を徹底解説します。

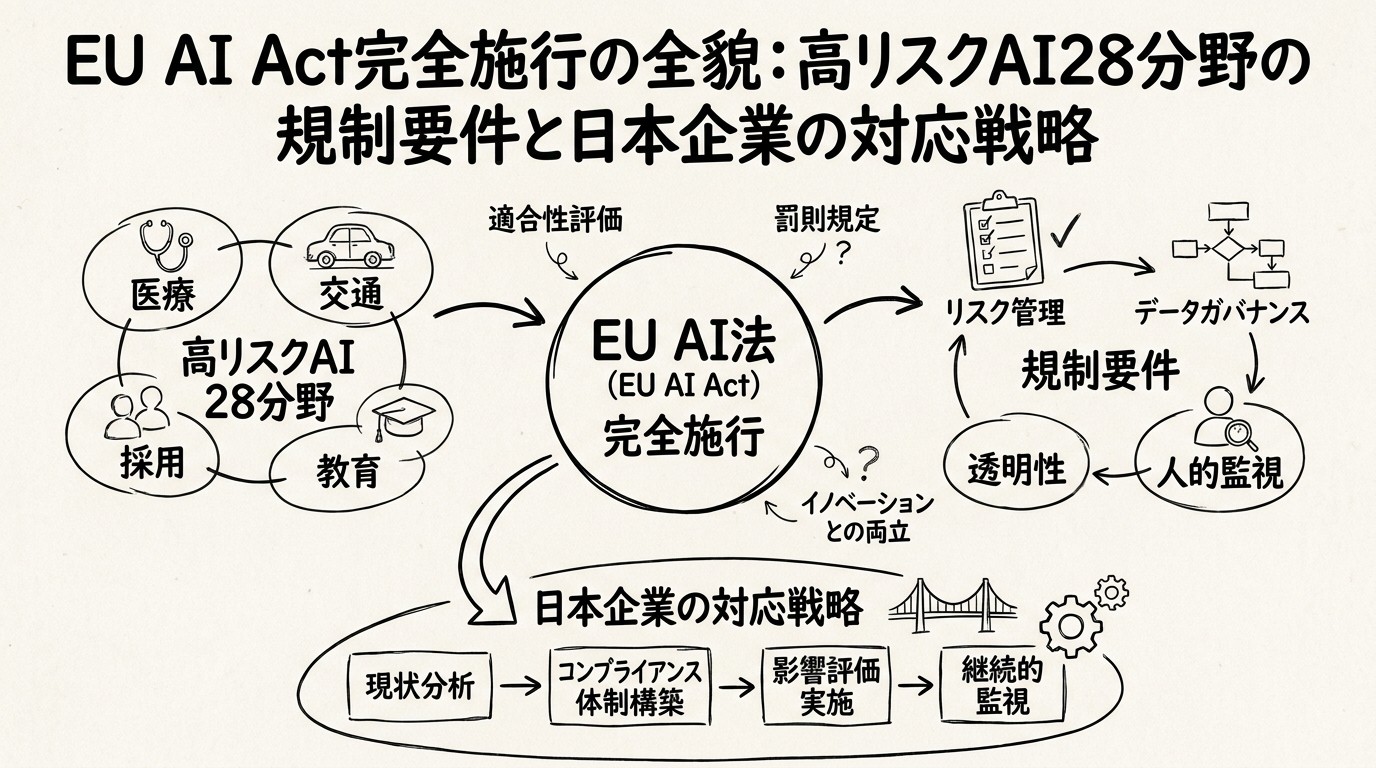

EU AI Actの構造:リスクベースアプローチとは

EU AI Actは、AIシステムのリスクレベルに応じて4つの規制カテゴリを設けています。

図1: EU AI Actのリスク分類ピラミッド — 禁止・高リスク・限定リスク・最小リスクの4段階

1. 禁止されるAI(Unacceptable Risk)

以下のAIシステムは、EU域内での開発・提供・利用が全面的に禁止されています(2025年2月に発効済み)。

- サブリミナル操作: 人の意識下に働きかけて行動を操作するAI

- 脆弱性の悪用: 年齢・障害・社会的状況に基づく脆弱性を悪用するAI

- ソーシャルスコアリング: 政府による社会的行動に基づく市民の格付けシステム

- リアルタイム遠隔生体認証: 公共空間での法執行目的のリアルタイム顔認識(例外あり)

- 感情推論: 職場・教育機関での感情状態の推測AI(医療・安全目的を除く)

- 顔画像スクレイピング: インターネットやCCTV映像からの無差別な顔画像データベース構築

2. 高リスクAI(High Risk)

今回完全施行された規定の中核です。特定の28分野で使用されるAIシステムには、厳格な義務的要件が適用されます(詳細は次セクション)。

3. 限定リスクAI(Limited Risk)

チャットボット・感情認識AI・ディープフェイク生成AIなど、透明性義務のみが課されるカテゴリです。ユーザーに「AIと対話していること」「コンテンツがAI生成であること」を明示する義務があります。

4. 最小リスクAI(Minimal Risk)

スパムフィルター・ゲームAI・推薦アルゴリズムなど、特別な規制なく自由に開発・提供できるカテゴリです。EU AI Actは、AIの大部分がこのカテゴリに属すると想定しています。

高リスクAI28分野の詳細

EU AI Actは、Annex III(附属書III)において、高リスクAIシステムの対象分野を具体的に列挙しています。大きく8つのカテゴリに分類されます。

カテゴリ別の高リスクAI分野

| カテゴリ | 対象分野 | 具体例 |

|---|---|---|

| 生体認証・分類 | リアルタイム遠隔生体認証、生体分類、感情認識 | 空港の顔認識ゲート、感情分析マーケティング |

| 重要インフラ | 道路交通安全、水道・ガス・電気・暖房供給の管理 | 自動運転車、スマートグリッド制御AI |

| 教育・職業訓練 | 入学判定、学習評価、試験監督、学習障害検出 | AI採点システム、不正検出AI |

| 雇用・労働者管理 | 採用・選考、昇進・解雇決定、業務配分、業績評価 | AIスクリーニング、勤怠管理AI |

| 公共サービスへのアクセス | 公的給付判定、信用スコアリング、緊急サービス優先度 | ローン審査AI、保険料算定AI |

| 法執行 | 犯罪予測、プロファイリング、証拠評価、量刑支援 | 予測的ポリシング、再犯リスク評価 |

| 移民・亡命・国境管理 | ビザ・滞在許可審査、亡命申請評価、入国リスク評価 | 出入国管理AI、リスクスクリーニング |

| 司法・民主的プロセス | 法的事実調査、法解釈支援、紛争解決、選挙影響 | リーガルリサーチAI、量刑支援AI |

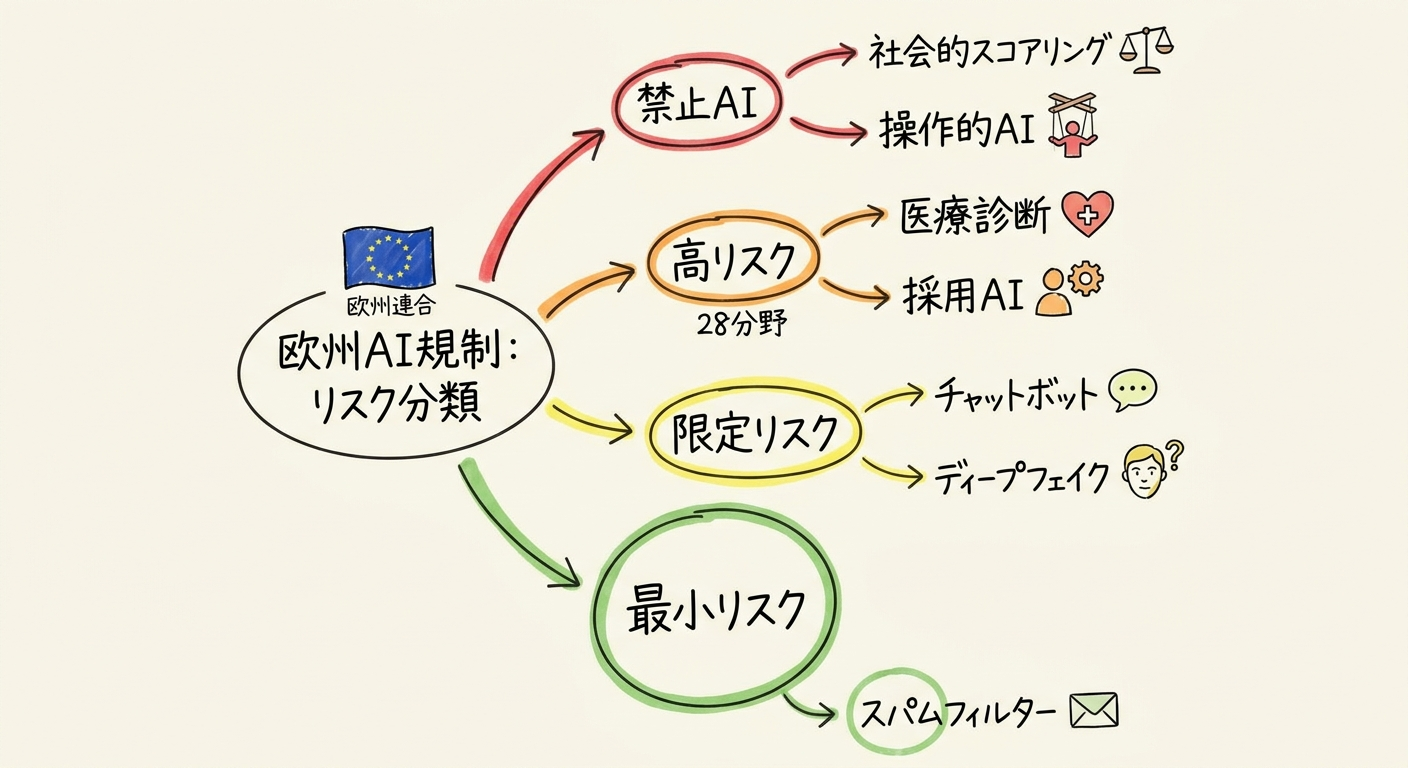

高リスクAIに課される6つの義務

高リスクAIシステムを開発・提供する事業者には、以下の義務が課されます。

図2: EU AI Actが高リスクAIに課す6つの義務 — リスク管理からCEマーキングまで

1. リスク管理システム(Article 9)

AIシステムのライフサイクル全体にわたるリスク評価・軽減措置の実施が義務付けられます。設計段階でのリスク特定、開発中の継続的モニタリング、運用後のインシデント対応プロセスの確立が必要です。

2. データガバナンス(Article 10)

学習データの品質管理、バイアス検出・是正プロセスの確立、データの代表性・正確性・完全性の確保が求められます。特に、保護属性(人種・性別・年齢など)に基づく差別的なバイアスの排除が重視されます。

3. 技術文書(Article 11)

AIシステムの設計・開発・評価に関する詳細な技術文書の作成・保持が義務付けられます。システムの目的、アーキテクチャ、学習データ、評価指標、既知の限界などを包括的に文書化する必要があります。

4. 記録保持(Article 12)

AIシステムの動作ログを自動的に記録し、監査証跡を確保する仕組みが求められます。インシデント発生時の原因追跡、規制当局への報告、事後監査への対応に必要です。

5. 透明性・情報提供(Article 13)

利用者への適切な情報提供、AIによる決定であることの明示、システムの能力と限界に関する説明が義務付けられます。「ブラックボックス」ではなく、理解可能で説明可能なAIが求められます。

6. 人間による監督(Article 14)

高リスク決定における人間によるレビュー・介入メカニズムの確保が必須です。AIの判断を人間が覆す能力、異常検知時の警告、システム停止権限の付与などが含まれます。

適合性評価とCEマーキング

高リスクAIシステムをEU市場に投入するためには、適合性評価を経てCEマーキングを取得する必要があります。

| 分野 | 適合性評価方式 | 評価主体 |

|---|---|---|

| 製品安全規制対象(医療機器等) | 第三者認証 | 認証機関(Notified Body) |

| その他の高リスクAI | 自己適合宣言 + 監査 | 事業者自身(当局監査あり) |

| 生体認証・法執行AI | 第三者認証 | 認証機関(Notified Body) |

制裁金:GDPRを上回る厳格さ

EU AI Act違反に対する制裁金は、GDPRを上回る厳格さを持っています。

| 違反内容 | 最大制裁金 |

|---|---|

| 禁止AIシステムの提供・利用 | 3,500万ユーロ または 年間売上高の7%(高い方) |

| 高リスクAI義務違反 | 1,500万ユーロ または 年間売上高の3%(高い方) |

| 虚偽情報の提供 | 750万ユーロ または 年間売上高の1%(高い方) |

中小企業(SME)および新興企業には、制裁金の上限が低く設定されるなど、一定の配慮がなされています。

「ブリュッセル効果」の発動

EU AI Actの影響はEU域内にとどまりません。「ブリュッセル効果」と呼ばれる現象により、EU規制がグローバルスタンダードとして機能することが予測されています。

ブリュッセル効果のメカニズム

- 市場規模: EUは4億5,000万人の消費者を擁する世界最大級の単一市場

- コスト効率: EU向けと非EU向けで別製品を開発するより、全製品をEU基準に合わせる方が効率的

- 先行者利益: 早期にEU基準を満たせば、他地域での規制対応にも先行できる

実際に、主要AIラボはすでにグローバル展開製品でのEU AI Act準拠を宣言しています。

- Microsoft: 2026年4月に全Azure AI製品でのEU AI Act準拠を発表

- Google: Geminiファミリー全モデルでEU基準を満たすことを確認

- Anthropic: ClaudeのエンタープライズプランでEU AI Act準拠を標準化

- OpenAI: 4月22日に包括的なEU対応計画を発表、GPTシリーズ全製品で準拠

日本企業への影響と対応戦略

直接適用される企業

以下の日本企業は、EU AI Actの直接的な適用対象となります。

- EU市場でAIサービスを提供する企業: SaaS・プラットフォームサービス提供者

- EU企業にAIコンポーネントを供給する企業: AI部品・モジュールの供給者

- EU域内に子会社・支店を持つ企業: 現地法人を通じた事業展開者

- EU市民のデータを処理するAI: 国境を越えたサービス提供者

日本のAI事業者ガイドライン改定との関係

総務省・経済産業省は「AI事業者ガイドライン」(現行は第1.1版)の継続的な改定検討を進めており、EU AI Act との「相互運用性(Interoperability)」確保が主要論点となっています。改定案の公表・適用時期は両省の公式発表を待つべきです(最新情報は soumu.go.jp / meti.go.jp を参照)。

一般論として日本ガイドラインは EU AI Act と以下の点で異なります(現行版ベース):

| 項目 | EU AI Act | 日本AI事業者ガイドライン(第1.1版) |

|---|---|---|

| リスク分類 | 4段階(禁止・高リスク・限定・最小) | 主体別の責務を整理(ソフトロー) |

| 適合性評価 | 第三者認証 or 自己宣言 | 自主的な実施(法的義務ではない) |

| 制裁金 | 法的拘束力あり(最大売上高7%) | 法的拘束力なし |

| 相互承認 | 未整備 | 未整備 |

将来的に日本での適合性評価が EU市場でも認められる「相互承認」の枠組みは、現時点では政策課題として議論の対象です。

日本企業の具体的対応ステップ

Step 1: 対象AIシステムの棚卸し(〜2026年Q2)

- 自社が開発・提供するAIシステムの一覧を作成

- 各システムがEU AI Actのどのリスクカテゴリに該当するか評価

- EU市場・EU顧客との接点を整理

Step 2: ギャップ分析(2026年Q2〜Q3)

- 現状の開発プロセス・ガバナンス体制と、EU AI Act要件との差分を特定

- リスク管理・データガバナンス・文書化・透明性の各領域での不足点を洗い出し

- 対応の優先順位付け

Step 3: コンプライアンス体制の構築(2026年Q3〜Q4)

- リスク管理システムの設計・実装

- 技術文書テンプレートの整備

- 人間監督メカニズムの組み込み

- 記録保持・監査証跡の仕組み構築

Step 4: 適合性評価の実施(2026年Q4〜2027年Q1)

- 第三者認証が必要な分野は認証機関との連携

- 自己適合宣言分野は内部評価・文書化

- CEマーキング取得手続き

Step 5: 継続的モニタリング(2027年〜)

- 運用後のインシデント対応体制

- 規制当局への報告プロセス

- 改定規制への継続対応

「コンプライアンス・バイ・デザイン」の推進

最も効果的な対応は、新規AI開発プロジェクトの設計段階からEU AI Act要件を組み込む「コンプライアンス・バイ・デザイン」アプローチです。

設計段階で組み込むべき要素

- リスク評価フレームワークの標準化

- 学習データの品質管理・バイアス検出パイプライン

- 説明可能性(Explainability)の技術的実装

- 人間介入ポイントの明示的設計

- ログ記録・監査証跡の自動化

このアプローチは、事後的なコンプライアンス対応よりもコスト効率が高く、また「EU AI Act準拠」を製品の差別化要因として活用することも可能です。

業界別の影響と対応ポイント

医療・ヘルスケア

医療診断AI・治療支援AIは高リスクカテゴリに該当し、既存の医療機器規制(MDR)との整合性も求められます。AIによる診断結果の説明可能性、医師による最終判断の確保、患者への情報提供が重要です。

金融・保険

信用スコアリング・ローン審査・保険料算定AIは高リスクに分類されます。アルゴリズムの透明性、差別的バイアスの排除、異議申立プロセスの整備が必須です。

人材・HR

採用スクリーニング・業績評価・配置決定AIは高リスクです。候補者・従業員への説明義務、人間による最終決定権の確保、保護属性に基づく差別の禁止が重視されます。

教育

入学判定・成績評価・学習支援AIは高リスクカテゴリです。学生・保護者への透明性確保、教師による監督、個別事情への配慮が求められます。

まとめ:AI規制の新時代と日本企業の機会

EU AI Actの完全施行は、AI産業が「実験段階」から「責任ある社会実装段階」へ移行したことを象徴するマイルストーンです。規制は制約であると同時に、信頼性の高いAIを提供する企業にとっては競争優位の源泉でもあります。

日本企業にとって、EU AI Act対応は「コスト」ではなく「投資」として捉えるべきです。EU対応を通じて構築したガバナンス体制・開発プロセスは、日本国内の規制強化にも先行対応できるアセットとなります。また、「EU AI Act準拠」を謳えることは、グローバル市場での信頼性の証明として機能します。

AI COMMONでは、EU AI Act対応コンサルティング、AIガバナンス体制の構築支援、適合性評価準備支援など、日本企業のグローバルAI規制対応を包括的にサポートしています。

AI COMMONでは、EU AI Act対応コンサルティングから、AIガバナンス体制の構築、適合性評価の準備まで、お客様のグローバルAI規制対応を包括的にサポートしています。 EU市場展開をご検討の方、国内ガイドライン改定への先行対応をお考えの方は、ぜひお気軽にご相談ください。

関連記事

- 週間AIニュース(2026年04月20日週)- EU AI Act完全施行でAI企業に激震、Google I/O 2026でGemini 3.5発表

- 米国家AI政策枠組みの全容:州規制排除とEU AI Actとの対照が示す国際AI規制の分岐

- AnthropicのARR300億ドル突破とClaude Mythos:エンタープライズ粘着性戦略がAI覇権を塗り替える

- 2026年AIガバナンス完全ガイド:企業のためのリスク管理と倫理的AI運用

参考文献

-

European Commission「Artificial Intelligence Act: Entry into Force and Application Timeline」

https://digital-strategy.ec.europa.eu/en/policies/regulatory-framework-ai -

European Commission「AI Act: Annex III - High-Risk AI Systems」

https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:32024R1689 -

European Commission「AI Act: Conformity Assessment Procedures」

https://digital-strategy.ec.europa.eu/en/policies/ai-conformity-assessment -

経済産業省・総務省「AI事業者ガイドライン検討会」

https://www.meti.go.jp/shingikai/mono_info_service/ai_shakai_jisso/index.html -

Microsoft「EU AI Act Compliance (Trust Center)」

https://www.microsoft.com/en-us/trust-center/compliance/eu-ai-act -

Google Cloud「EU AI Act - Compliance」

https://cloud.google.com/security/compliance/eu-ai-act -

Anthropic「Anthropic to sign the EU Code of Practice」(2025年7月21日)

https://www.anthropic.com/news/eu-code-practice -

OpenAI「A Primer on the EU AI Act: What It Means for AI Providers and Deployers」

https://openai.com/global-affairs/a-primer-on-the-eu-ai-act/ -

European Commission「The General-Purpose AI Code of Practice」

https://digital-strategy.ec.europa.eu/en/policies/contents-code-gpai -

Bradford, Anu「The Brussels Effect: How the European Union Rules the World」Columbia University Press (2020)

📢この記事をシェアしませんか?

おすすめの投稿:

EU AI Act完全施行で高リスクAI28分野に厳格規制が開始。医療診断・採用・信用スコアリングのAIに適合性評価が義務化。違反時の制裁金は売上高の最大7%。日本企業の対応戦略を解説

引用しやすいフレーズ:

“EU AI Act完全施行 — 高リスクAI28分野が法的拘束力を持つ規制対象に、AI産業の成熟を示すマイルストーン”

“違反時の制裁金は売上高の最大7% — GDPRを上回る厳格さでグローバルAI規制の基準を確立”

“ブリュッセル効果が発動 — EU対応がそのままグローバルスタンダードに、Microsoft・Google・Anthropicは全世界で準拠を宣言”

“日本のAI事業者ガイドライン改定 — EUとの相互運用性確保が焦点、適合性評価の相互承認も視野”

“コンプライアンス・バイ・デザイン — 設計段階からEU要件を組み込むことが競争優位の源泉に”